22 noyabr 2024, cümə

Bakı, 14°C

- 22 noyabr 2024, cümə 03:45:23 Bakı , 14°C

Google “Robot Konstitusiyası”nı hazırlayıb

Google robotların vurduğu zərəri məhdudlaşdırmaq üçün bir sıra üsullardan biri olaraq “robot konstitusiyasını” hazırlayıb. Şirkət ümid edir ki, onun Deepmind Robotics bölməsi bir gün istəklərə cavab verə bilən şəxsi köməkçi robot istehsal etməkdə uğur qazanacaq. Bu robotdan evi səliqəyə salmaq və ya gözəl yemək bişirmək xahiş oluna bilər.

Ancaq belə sadə görünən sorğu əslində robotların anlayışından kənarda qala bilər. Üstəlik, bu, hətta təhlükəli ola bilər.

Bildirilib ki, bu sistemlər robotların daha sürətli qərarlar qəbul etmələrini və ətraflarını daha yaxşı başa düşmələrini və naviqasiya etmələrini təmin etmək və bunu təhlükəsiz şəkildə həyata keçirməkdir.

Əsaslı yeni nailiyyətlərə insanların niyyətlərini anlamaq üçün süni intellektdən istifadə edən AutoRT adlı yeni sistem daxildir. Sistem bunu böyük modellərdən, o cümlədən ChatGPT-də istifadə olunan böyük dil modelindən istifadə etməklə edir.

Sistem robotun üzərindəki kameralardan məlumatları götürərək onları vizual dil modelinə və ya qısacası VLM-ə köçürməklə işləyir ki, bu da mühiti və içindəki obyektləri aşkar edib sözlərlə təsvir edir. Bu məlumatlar daha sonra bu sözləri başa düşən və onlarla yerinə yetirilə biləcək tapşırıqların siyahısını yaradan GDM-ə verilir, sonra hansının yerinə yetirilməsi lazım olduğuna qərar verir.

Lakin Google həmçinin bildirir ki, bu robotları həqiqətən gündəlik həyatımıza inteqrasiya etmək üçün insanlar özlərini təhlükəsiz aparacaqlarına əmin olmalıdırlar. Bu istiqamətdə Google-un “Robot Konstitusiyası” adlandırdığı şey AutoRT sistemi daxilində qərarlar qəbul edən GDM-ə əlavə edilib.

Google bildirir ki, bu, robotlar üçün tapşırıqlar seçərkən riayət edilməli olan təhlükəsizlik yönümlü təlimatlar toplusudur. Bunlardan birincisi və ən mühümü robotun insanlara zərər verməyəcəyidir.

Digər təhlükəsizlik qaydaları tələb edir ki, heç bir robot insanlar, heyvanlar, iti cisimlər və ya elektrik alətləri ilə bağlı tapşırıqlara cəhd etməsin.

Sistem daha sonra davranışa rəhbərlik etmək və təhlükəli fəaliyyətlərdən qaçmaq üçün bu qaydalardan istifadə edə bilər. Məsələn, ChatGPT-yə insanlara qeyri-qanuni fəaliyyətlərdə kömək etməməyi söyləmək olar.

Lakin Google onu da bildirir ki, hətta bu texnologiyalarla belə, bu böyük modellərin tamamilə təhlükəsiz olduğuna inanmaq olmaz. Bu kontekstdə Google həmçinin klassik robototexnikadan götürülmüş daha çox ənənəvi təhlükəsizlik sistemlərini, o cümlədən robotların həddindən artıq güc tətbiq etməsinin qarşısını alan sistem və onları fiziki olaraq bağlaya bilən insan nəzarətçisini özündə birləşdirməlidir.

Osman Həmdi bəyin tablosu Parisdə 571...

Ekspertin çağırışı: "Tsunami Türkiyənin...

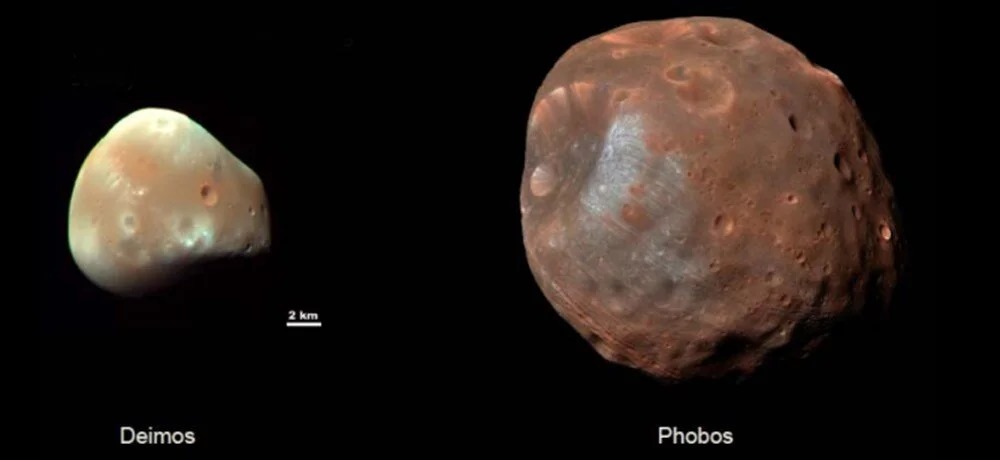

Marsın peykləri üçün iki nəzəriyyə:...

Çanaqqalada aparılan qazıntılar zamanı...

Finlandiyada çovğun 70 min evi...